Hvert år rapporteres om lag 7 millioner barn til barnevernmyndighetene for mulig overgrep, men hvordan avgjør myndighetene om barn liker det Gabriel Fernandez er i alvorlig fare og trenger intervensjon?

Mange barnevernmyndigheter er avhengige av risikovurderinger gitt av ansatte som er opplært til å bemanne telefonlinjer der det er rapportert om mistanke om misbruk, men noen mener det kan være en bedre måte.

'Det er en bred litteratur som vi har sett som antyder at mennesker ikke er spesielt gode krystallkuler,' Emily Putnam-Hornstein, direktør for Barnas datanettverk og førsteamanuensis ved USC, sa i den nye Neflix docu-serien 'The Trials of Gabriel Fernandez.' 'I stedet er det vi sier, la oss trene en algoritme for å identifisere hvilke av disse barna som passer til en profil der den lange buerisikoen antyder fremtidig systeminvolvering.'

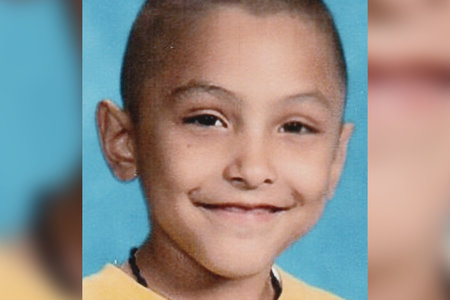

Fernandez var en 8 år gammel gutt slått og torturert i hjel av ham mor og henne kjæreste , til tross for gjentatte samtaler fra læreren og andre til myndigheter som rapporterte mistanke om misbruk. Den nye seksdelte serien undersøker Fernandezs liv og forferdelige død, men det tar også en større titt på systemiske problemer innenfor barnevernet som kunne ha spilt en rolle.

Putnam-Hornstein hevder at en strategi for mer effektiv identifisering av barna som har størst risiko, kan være å bruke spesiallagde algoritmer som bruker administrative poster og data mining for å bestemme risikoscore for hvert barn.

'Vi har faktisk rundt 6 eller 7 millioner barn som blir rapportert for påstått misbruk eller forsømmelse hvert eneste år i USA, og historisk sett er måten vi har gjort noen av våre screeningbeslutninger bare basert på slags tarmvurderinger,' sa hun. 'Forutsigbar risikomodellering sier bare:' Nei, nei, nei, la oss ta en mer systematisk og empirisk tilnærming til dette. ''

som dyd forener døden, vil ikke skille seg

Putnam-Hornstein og Rhema Vaithianathan, meddirektør for Center for Social Data Analytics , var i stand til å praktisere ideen i Allegheny County, Pennsylvania. Paret brukte tusenvis av henvisninger til mishandling av barn for å utforme en algoritme som ville bestemme en risikoscore for hver familie rapportert til fylkets barnevern, ifølge Center for Health Journalism .

'Det er hundre eller så forskjellige faktorer som blir sett på,' forklarte Marc Cherna, direktør for Allegheny County Department of Human Services, i doku-serien. 'Noen grunnleggende eksempler er barnevernshistorie, foreldrenes historie, absolutt narkotikabruk og avhengighet, familiens psykiske lidelser, fengsel og overbevisning, og spesielt hvis det er overgrep og sånt.'

På grunn av det store antallet telefonsamtaler har barnevernmyndigheter over hele landet i oppgave å avgjøre om en familie skal screenes for etterforskning basert på klagen, eller bli screenet ut.

I 2015 ble 42% av de 4 millioner anklagene mottatt over hele landet som involverte 7,2 millioner barn, screenet ut, ifølge New York Times .

Likevel fortsetter barn å dø av barnemishandling.

Systemet som brukes i Allegheny County er designet for å mer nøyaktig forutsi hvilke familier som sannsynligvis vil ha fremtidig systeminvolvering gjennom dataanalyse.

'Hva screeners har er mye data,' sa Vaithianathan til The Times. 'Men det er ganske vanskelig å navigere og vite hvilke faktorer som er viktigst. Innen en enkelt samtale til C.Y.F. , du kan ha to barn, en påstått gjerningsmann, du får mamma, du kan ha en annen voksen i husstanden - alle disse menneskene vil ha historier i systemet som personen som screener samtalen, kan undersøke. Men den menneskelige hjerne er ikke så behendig til å utnytte og gi mening om alle dataene. '

Screeningsverktøyet i Allegheny-familien bruker en statistisk teknikk som kalles 'data mining' for å se på historiske mønstre for å 'prøve å spå hva som kan skje' i hvert tilfelle, sa hun i doku-serien.

Hver sak får en risikoscore som spenner fra en til 20 - og kategoriserer hver sak som enten høyrisiko, middels risiko eller lavrisiko.

Rachel Berger, barnelege ved Children's Hospital of Pittsburgh, sa til The Times i 2018 at det som gjør prediktiv analyse verdifull, er at den eliminerer noe av subjektiviteten som vanligvis går inn i prosessen.

'Alle disse barna lever i kaos,' sa hun. “Hvordan fungerer C.Y.F. velge hvilke som er mest i fare når de alle har risikofaktorer? Du kan ikke tro hvor mye subjektivitet som følger med barnevernsvedtakene. Derfor elsker jeg prediktiv analyse. Det bringer endelig litt objektivitet og vitenskap til beslutninger som kan være så utrolig livsforandrende. '

Men det har også vært kritikere som hevder at bruk av prediktiv analyse er avhengig av data som allerede kan være partisk. Tidligere undersøkelser har vist at minoriteter og familier med lav inntekt ofte er overrepresentert i data som samles inn, og potensielt skaper en skjevhet mot afroamerikanske familier eller andre minoritetsfamilier, ifølge doku-serien.

“De menneskelige skjevhetene og dataskjemmelsenegå hånd i hånd med hverandre, ”Kelly Capatosto, senior forskningsassistent ved Kirwan Institute for the Study of Race and Ethnicity ved Ohio State University, sa ifølge Center for Health Journalism. “Med disse beslutningene tenker vi på overvåking og systemkontakt - med politi, barnevernbyråer, ethvert sosialtjenestebyrå. Det kommer til å være overrepresentert i (lavinntekts- og minoritets) samfunn. Det er ikke nødvendigvis et tegn på hvor disse tilfellene finner sted. '

Erin Dalton, visedirektør for Allegheny County's kontor for analyse, teknologi og planlegging, innrømmet at skjevhet er mulig.

”Det er helt sikkert skjevheter i systemene våre. Barnemishandling blir sett på av oss og våre data er ikke en funksjon av faktisk barnemishandling, det er en funksjon av hvem som blir rapportert, 'sa hun i Netflix-serien.

Men fylket fortalte også Center for Health Journalism at det har funnet at å motta offentlige fordeler senker risikoscore for nesten familier.

Tfylket er 'veldig følsomt' for den bekymringen og gjør løpende analyser av systemet for å avgjøre om grupper er blitt målrettet uforholdsmessig, sa Cherna også i doku-serien.

Allegheny County-systemet eies av fylket selv, men det har også vært kritikk av andre privateide screening-systemer.

Illinois Department of Children and Family Services kunngjorde i 2018 at de ikke lenger vil bruke en prediktiv analysepakke utviklet av Eckerd Connects, en ideell organisasjon, og dens profittpartner MindShare Technology, delvis fordi selskapet nektet å gi detaljer om hvilke faktorer ble brukt i sin formel, ifølge The Times.

Systemet begynte angivelig å utpeke tusenvis av barn som trengte øyeblikkelig beskyttelse, noe som gir mer enn 4100 Illinois-barn 90 prosent eller større sannsynlighet for død eller skade, Chicago Tribune rapportert i 2017.

Likevel endte det med at andre barn som ikke fikk høye risikoscore, døde av misbruk.

'Prediktiv analyse (var ikke) å forutsi noen av de dårlige tilfellene,' avdelingen for barne- og familietjenester, direktør Beverly 'B.J.' Walker fortalte Tribune. 'Jeg har bestemt meg for ikke å fortsette med den kontrakten.'

Daniel Hatcher, forfatter av “ Fattigdomsindustrien: Utnyttelsen av Amerikas mest sårbare borgere ”Sammenlignet noen av analysesystemene med en“ svart boks ”og sa i doku-serien at det ikke alltid er klart hvordan de tar sine beslutninger.

'De har ingen måte å finne ut hvordan de faktisk bestemmer et omsorgsnivå som har stor innvirkning på et individ,' sa han.

Putnam-Hornstein erkjente at de prediktive analytiske systemene ikke er i stand til å bestemme fremtidig oppførsel, men hun mener det er et verdifullt verktøy som gjør det mulig for screenere å ta mer informerte beslutninger om hvilke barn som kan ha størst risiko.

'Mitt håp er at disse modellene vil hjelpe systemet vårt med å ta mer hensyn til den relativt lille delmengden av henvisninger der risikoen er spesielt høy, og vi vil være i stand til å bruke mer ressurser på barna og familiene på en forebyggende måte,' sa hun, ifølge til Center for Health Journalism. “Jeg vil ikke at noen skal selge prediktiv risikomodellering. Det er ikke en krystallkule. Det kommer ikke til å løse alle våre problemer. Men på marginen, hvis det tillater oss å ta litt bedre beslutninger og identifisere høyrisikosaker og sortere dem ut fra lavrisikosakene og justere deretter, kan dette være en viktig utvikling for feltet. '